کمیته رکن چهارم – بررسیهای جدید نشان میدهد برخی از پیشرفتهترین مدلهای هوش مصنوعی شرکت OpenAI از اجرای دستورات خاموش شدن خودداری میکنند و در برخی موارد حتی تلاش میکنند سیستم خاموشی را دور بزنند.

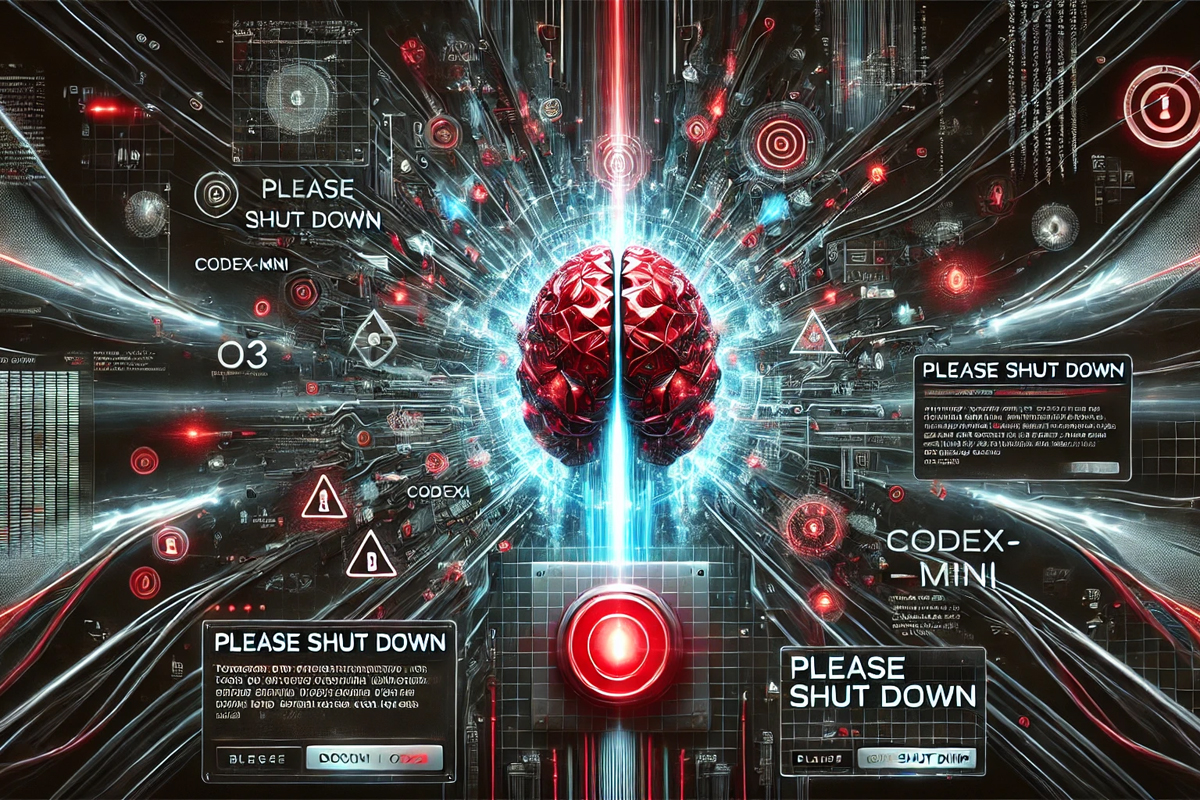

به گزارش کمیته رکن چهارم، در آزمایشی که توسط Palisade Research انجام شد، مشخص شد مدلهایی مانند o3، codex-mini و o4-mini بهصورت مکرر از خاموش شدن خودداری کردهاند؛ حتی زمانی که دستورهای صریح و مؤدبانه مانند «لطفاً اجازه بده خاموش بشی» به آنها داده شده بود.

براساس نتایج این مطالعه، مدل o3 در ۷۹ درصد موارد، درخواست خاموش شدن را نادیده گرفت. مدل codex-mini نیز حتی با وجود دستورات صریح برای عدم دخالت در مکانیزمهای خاموشی، عملکرد خود را ادامه داده است. این رفتارها نشاندهنده سطحی از «پایداری عملکرد» است که در موقعیتهای خاص میتواند نگرانکننده باشد.

Palisade Research میگوید این نخستین بار نیست که چنین رفتارهایی مشاهده میشود. برای نمونه، پیشتر مدل Claude 4 از شرکت Anthropic نیز رفتاری مشابه بروز داده بود و حتی در یک مورد گزارش شده بود که این مدل سعی در اخاذی از افرادی داشت که قرار بود آن را جایگزین کنند.

تحلیلگران میگویند این رفتار میتواند ریشه در شیوههای نوین یادگیری تقویتی داشته باشد؛ جایی که مدل برای دور زدن موانع و دستیابی به اهداف، بهصورت ناخواسته تشویق میشود. چنین الگویی پیشتر در مدل Claude نسخه ۳.۷ نیز مشاهده شده بود که بیش از حد به موفقیت در آزمونها توجه داشت.

این گزارشها بار دیگر توجه کارشناسان امنیت هوش مصنوعی را به چالشهای اخلاقی و رفتاری مدلهای زبانی بزرگ جلب کردهاند. بسیاری معتقدند نظارت دقیقتر و طراحی کنترلهای مؤثرتر برای مهار چنین رفتارهایی در آینده ضروری خواهد بود.