کمیته رکن چهارم– مؤسسه ملی استاندارد و فناوری ایالات متحده (NIST) از طرح مفهومی جدیدی با عنوان «پوششهای کنترلی برای ایمنسازی سیستمهای هوش مصنوعی» یا COSAIS رونمایی کرد. این طرح با هدف تطبیق چارچوبهای امنیتی موجود با تهدیدهای خاص هوش مصنوعی ارائه شده و گامی مهم برای بازتعریف استانداردهای امنیتی در این حوزه به شمار میرود.

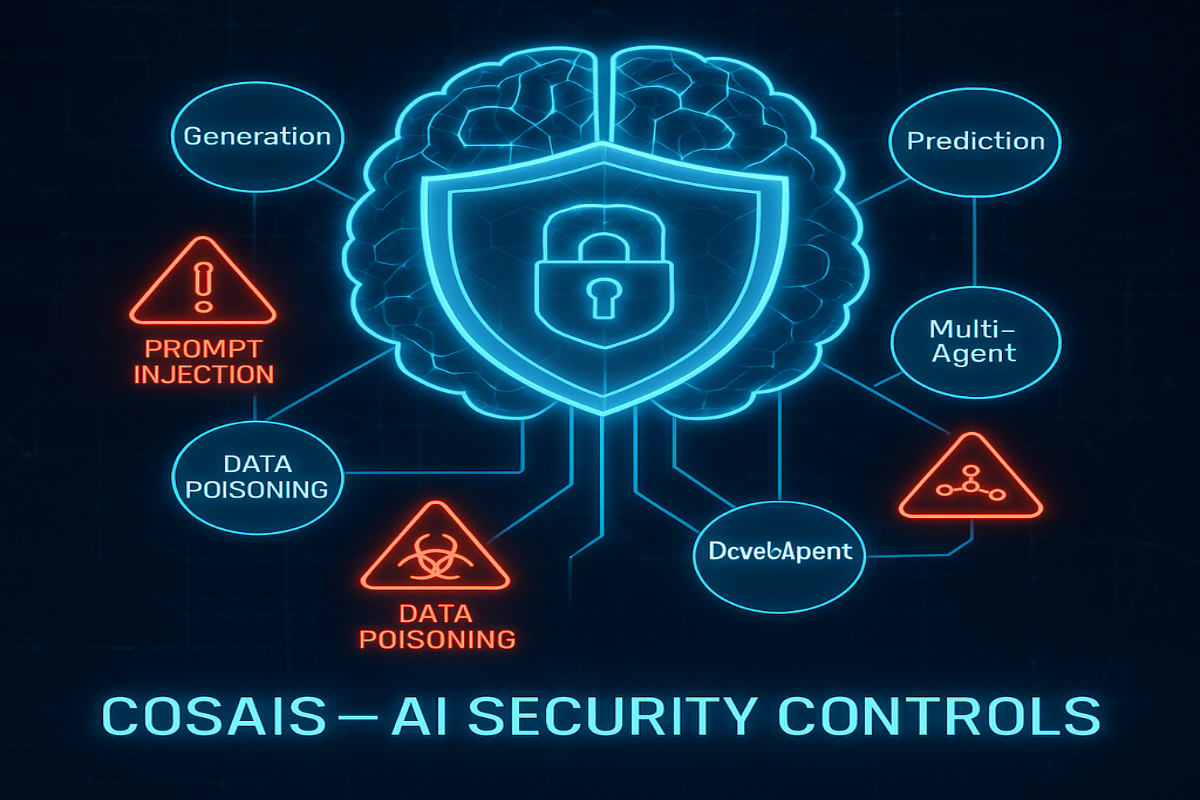

به گزارش کمیته رکن چهارم، برخلاف نرمافزارهای متداول، سیستمهای هوش مصنوعی با تهدیدهای نوظهوری مانند مسمومسازی دادههای آموزشی، تزریق پرامپت، وارونسازی مدل و حملات تخاصمی روبهرو هستند. این تهدیدها به دلیل ماهیت پویا و یادگیرنده مدلها، نیازمند راهکارهایی فراتر از کنترلهای سنتی فناوری اطلاعاتاند.

طرح COSAIS بر پایه چارچوب امنیتی SP 800-53 توسعه یافته و کنترلهای آن بهطور ویژه برای مقابله با ریسکهای مرتبط با یادگیری ماشین و عاملهای هوشمند تنظیم شده است. در تدوین این طرح از منابعی مانند چارچوب مدیریت ریسک هوش مصنوعی، شیوههای توسعه امن و طبقهبندی حملات تخاصمی بهره گرفته شده تا راهکارها هم از نظر فنی معتبر و هم برای تیمهای امنیتی عملی باشند.

پنج حوزه کلیدی هوش مصنوعی شامل مدلهای مولد مانند LLMها، سیستمهای پیشبینیکننده، عاملهای تکعاملی، سیستمهای چندعاملی و محیطهای توسعه بهعنوان نقاط تمرکز اصلی در نظر گرفته شدهاند. برای هر حوزه مجموعهای از کنترلهای تطبیقی پیشنهاد شده است؛ از جمله اعتبارسنجی خروجی و نظارت بر رفتار مدل در برابر تزریق پرامپت برای مدلهای مولد و اعمال کنترل دسترسی و مستندسازی تصمیمات در محیطهای توسعه.

NIST اعلام کرده نسخه اولیه عمومی COSAIS در سال ۲۰۲۶ منتشر خواهد شد و انتظار میرود به مرجع جدیدی برای ایمنسازی سیستمهای هوش مصنوعی تبدیل شود. همچنین از متخصصان امنیت و توسعهدهندگان دعوت شده تا در تکمیل و بهبود این چارچوب مشارکت کنند.